세계 최초로 젠슨황은 2025년 말 깐부치킨에서 닭다리를 뜯으면서 인공지능 사업을 논의했고, 1945년 경 폰 노이만은 진공관을 사용하여 세계 최초의 고전적 유형의 에니악 CPU 컴퓨터를 만들었다. 스티브잡스는 1970년대 세계 최초로 개인용 애플 PC 를 , IBM은 8086 개인 컴퓨터를 발매했다. 한편 양자역학 분야 노벨 수상자였던 칼텍의 파인만 교수는 1981년 말에 양자 컴퓨팅의 잠재적인 가능성을 기반으로 하는 컴퓨터의 출현 가능성을 언급했다.

Prompt: 파인만 교수가 양자역학이 복잡계 컴퓨팅을 위한 단서가 되지 않을까 라고 언급했다는 문헌을 찾을 수 있을까요?

리처드 파인만(Richard Feynman) 교수가 양자역학을 이용한 컴퓨팅의 가능성을 처음으로 제시한 것은 과학사에서 매우 중요한 순간으로 기록되어 있습니다.

결론부터 말씀드리면, 질문하신 내용은 **1981년 MIT와 IBM이 공동 주최한 '물리학과 컴퓨팅에 관한 제1회 컨퍼런스(First Conference on the Physics of Computation)'**에서의 강연 내용을 찾으시면 됩니다.

1. 핵심 문헌: "Simulating Physics with Computers"

파인만 교수는 1981년 강연을 바탕으로 1982년에 **<Simulating Physics with Computers>**라는 기념비적인 논문을 발표했습니다.

- 학술지: International Journal of Theoretical Physics, Vol. 21, Nos. 6/7, 1982.

- 핵심 주장: > "자연은 고전적이지 않습니다. 만약 당신이 자연의 시뮬레이션을 만들고 싶다면, 당신은 그것을 **양자역학적(Quantum Mechanical)**으로 만들어야 합니다."

2. 왜 '복잡계'와 관련이 있나요?

파인만 교수가 양자 컴퓨터를 제안한 근본적인 이유는 고전 컴퓨터의 한계 때문이었습니다.

- 지수적 복잡성: 일반적인 컴퓨터(고전 컴퓨터)로 양자역학적 시스템(입자가 많은 복잡한 시스템)을 시뮬레이션하려면, 입자 수가 늘어날 때마다 필요한 계산 자원이 기하급수적으로 증가합니다.

- 해결책: 파인만은 "양자 시스템 그 자체의 원리로 작동하는 컴퓨터를 만든다면, 자연의 복잡한 물리 현상을 훨씬 효율적으로 시뮬레이션할 수 있을 것"이라고 통찰했습니다.

3. 문헌을 찾는 방법

이 강연의 전문이나 논문을 확인하고 싶으시다면 다음 키워드로 검색해 보시는 것을 추천합니다.

- Google Scholar 검색어: Feynman Simulating Physics with Computers 1982

- 강연 영상/기록: 유튜브나 MIT 아카이브에서 Feynman Physics of Computation 1981을 검색하면 당시의 분위기와 기록물들을 접하실 수 있습니다.

파인만의 이 제안은 당시에는 매우 파격적이고 공상과학처럼 들렸지만, 오늘날 구글, IBM 등이 개발 중인 **양자 컴퓨터(Quantum Computer)**의 이론적 시초가 되었습니다.

이 논문의 구체적인 수식이나 파인만이 지적한 '고전 컴퓨터의 한계'에 대해 더 자세히 알고 싶으신가요?

파인만이 지적한 '고전 컴퓨터의 한계' 와 관련 수식에 대해 더 자세히 알고 싶군요!

리처드 파인만(Richard Feynman)은 1981년 "Simulating Physics with Computers"라는 기념비적인 강연을 통해 양자 컴퓨터의 필요성을 역설했습니다. 그가 지적한 고전 컴퓨터의 핵심적인 한계는 '지수적 폭발(Exponential Explosion)' 문제입니다.

1. 고전 컴퓨터의 근본적 한계: 시뮬레이션의 비효율성

파인만은 자연(자연계의 미시 세계)이 고전적이지 않고 양자 역학적으로 작동한다는 점에 주목했습니다. 고전 컴퓨터로 양자 시스템을 정밀하게 흉내 내려고 하면, 계산량이 감당할 수 없을 정도로 커집니다.

지수적 복잡성

양자 시스템의 상태는 여러 상태의 '중첩'으로 존재합니다. 만약 우리가 N개의 양자 비트(큐비트)를 가진 시스템을 고전 컴퓨터로 시뮬레이션하려고 한다면, 이를 기술하기 위해 필요한 정보량은 다음과 같이 늘어납니다.

Qubit 하나당 0 과 1 의 중첩상태를 포함하므로 N Qubits 는 2의 N승만큼의 경우의 수를 동반한다.

- N=10일 때: 1,024개의 숫자를 저장하면 됩니다.

- N=50일 때: 약 1.1 x 10**15개의 숫자가 필요합니다. (현존하는 슈퍼컴퓨터의 한계치에 근접)

- N=300일 때: 필요한 상태의 수가 관측 가능한 우주의 원자 수보다 많아집니다.

즉, 고전 컴퓨터는 비트(0 또는 1)를 사용하기 때문에, 양자 역학의 확률 진폭을 저장하고 계산하는 데 있어 물리적인 한계에 봉착하게 됩니다.

2. 파인만이 제시한 핵심 수식과 개념

파인만은 고전적인 확률론으로는 양자 역학의 '간섭' 현상을 완벽하게 모사할 수 없음을 수학적으로 시사했습니다.

확률론적 한계 (Locality)

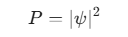

고전적인 확률 변수 P(A, B)는 항상 0 이상의 값을 가지며, 국소성(Locality)의 원리를 따릅니다. 하지만 양자 역학의 상태 함수 즉 확률파동 함수 프사이(ψ) 는 복소수 값을 가질 수 있으며, 확률 밀도는 다음과 같이 정의됩니다.

이 과정에서 발생하는 파동의 간섭 효과(Interference) 때문에, 고전적인 '숨은 변수' 모델로는 양자 시스템의 상관관계를 설명할 수 없습니다. 파인만은 "자연을 시뮬레이션하고 싶다면 컴퓨터를 양자 역학적으로 만들어야 한다"고 결론지었습니다.

3. 요약

| 구분 | 고전 컴퓨터 (Bit) | 양자 컴퓨터 (Qubit) |

| 기본 단위 | 0 또는 1 (배타적) | 0과 1의 중첩 ($\alpha |

| 상태 표현 | N개 비트로 N개 상태 표현 | N개 큐비트로 2^N개 상태 동시 표현 |

| 연산 방식 | 직렬/병렬 처리 (선형적) | 양자 간섭과 얽힘을 이용한 지수적 병렬성 |

| 한계 | 복잡한 분자 구조, 소인수 분해 등에서 지수적 시간 소요 | 특정 문제에서 다항 시간 내 해결 가능 |

파인만의 이 통찰은 이후 '양자 알고리즘'의 발전으로 이어졌고, 오늘날 우리가 구글이나 IBM의 양자 프로세서를 논하게 된 시발점이 되었습니다.

혹시 파인만이 제안했던 '양자 시뮬레이터'의 구체적인 작동 원리나, 이를 해결한 1992년에 발표된 쇼어(Shor) 알고리즘 같은 실제 사례에 대해 더 궁금하신가요?

'양자컴퓨팅 물리학' 카테고리의 다른 글

| 노량진 검정고시학원 수준으로 정리한 양자 역학과 슈뢰딩거 방정식, GL wave form (0) | 2026.02.27 |

|---|---|

| 양자 컴퓨팅 관문 돌파를 위한 블로그 목차 (0) | 2026.02.02 |

| 물리학자가 만드는 양자 컴퓨팅 명령들: 단일 큐비트 제어, 2개의 큐비트로 구성된 Transmon (0) | 2026.01.02 |

| 양자 컴퓨팅까지 ∙∙∙III 초전도체에 생성된 Cooper pair 의 Qubit 화 (1) | 2025.12.05 |

| 양자컴퓨팅 관문 돌파를 위한 블로그 목차(사본) (0) | 2025.11.21 |